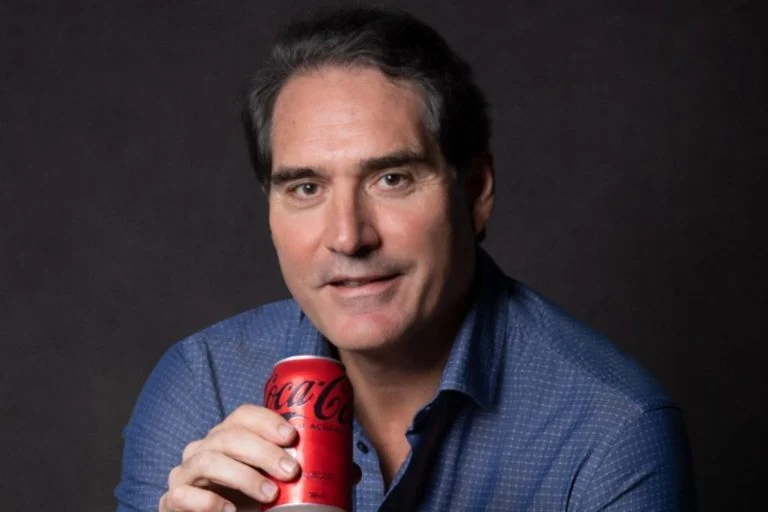

O Departamento de Justiça dos EUA vai levar a julgamento Albert Saniger, fundador da startup Nate, por suposta fraude contra investidores.

A empresa, que atraiu atenção prometendo uma tecnologia de inteligência artificial capaz de realizar compras online com apenas um clique, na verdade operava com base em trabalho humano.

De acordo com as autoridades americanas, a Nate levantou cerca de US$ 50 milhões (aproximadamente R$ 292,2 milhões) em investimentos sob a promessa de uma solução inovadora de automação.

No entanto, documentos do DOJ revelam que a operação não contava com nenhum sistema real de IA — a execução das compras era feita por operadores humanos em um call center nas Filipinas.

Embora a empresa tenha se apresentado como uma plataforma de tecnologia avançada, investigações apontam que o uso de inteligência artificial era insignificante. A fraude veio à tona em 2022, quando o site The Information revelou que quase todo o processo era manual, contradizendo diretamente o discurso de inovação tecnológica propagado por Saniger.

App prometia IA para facilitar compras, mas usava humanos

A proposta era sedutora: um app que automatizava compras online em diferentes sites com apenas um clique. Chamado nate, o aplicativo oferecia aos usuários a comodidade de reunir produtos de diversos e-commerces em um só lugar e finalizar o pedido de forma rápida, sem precisar preencher dados ou navegar entre abas — tudo isso por apenas US$ 1 por transação.

Mas a experiência que parecia futurista começou a levantar suspeitas quando usuários notaram que, em alguns casos, os pedidos levavam horas para serem concluídos. O que deveria ser instantâneo, graças à suposta inteligência artificial, estava longe da promessa.

Foi o site The Information que, em 2022, expôs o que realmente acontecia por trás do nate: um call center nas Filipinas era responsável por preencher manualmente os dados de pagamento, endereço e confirmar as compras — tarefa que deveria ser da IA. Segundo a reportagem, o uso de automação era mínimo, ao contrário do que o CEO e fundador, Albert Saniger, afirmava aos investidores.

De acordo com o Departamento de Justiça dos Estados Unidos (DOJ), Saniger omitiu a dependência de trabalho humano em apresentações para captar recursos, sustentando a narrativa de que o sistema era totalmente automatizado.

A startup levantou US$ 50 milhões (R$ 292,2 milhões) em investimentos baseados nessa premissa. O DOJ afirma que nem mesmo a maioria dos funcionários da empresa tinha acesso à verdade, já que Saniger restringia os dados internos para manter a ilusão.

Agora, o executivo enfrenta acusações formais de fraude de investimento e fraude digital, com penas que podem chegar a 20 anos de prisão para cada crime.

Startup de IA usava humanos em 70% das interações

A Presto, empresa que prometia revolucionar os drive-thrus com inteligência artificial, está no centro de mais um escândalo envolvendo falsas promessas de automação. Apresentada como uma solução baseada na API do ChatGPT, a tecnologia garantiria um atendimento automatizado em 95% das interações com os clientes.

Mas a realidade era outra: cerca de 70% dos pedidos feitos nos drive-thrus eram, na verdade, processados por operadores humanos — muitos deles em call centers nas Filipinas e em outros países da Ásia.

O caso veio à tona em 2023 e espelha o escândalo da nate, startup de compras online que também afirmava operar com IA, mas usava trabalho humano nos bastidores. Assim como naquela situação, a Presto enganava investidores ao inflar os números de automação e esconder a real estrutura do serviço.

A descoberta gerou forte reação no mercado, especialmente entre investidores que haviam colocado milhões de dólares em um produto que não entregava o que prometia. Além de minar a confiança em startups de tecnologia, casos assim dificultam o acesso a capital para empresas que realmente trabalham com soluções de IA legítimas.